por CHRISTINA KEFALA – Universidad de Ámsterdam

Después de que China cerró sus fronteras a los ciudadanos extranjeros debido a la pandemia de Covid-19, no pude viajar a Shanghái para realizar una investigación etnográfica para mi doctorado, como había previsto originalmente. Mi proyecto, que tenía como objetivo explorar las experiencias racializadas de los empresarios blancos de Europa y los Estados Unidos a través de una investigación de empresas extranjeras, tuvo que reconfigurarse radicalmente. Como muchos antropólogos, recurrí a la investigación online, combinando la recopilación de datos de archivo con el análisis de los medios y haciendo entrevistas en línea con los participantes a través de las plataformas de redes sociales. Durante dos años de investigación etnográfica digital, estructuré mi trabajo de campo como un proceso abierto en el que colaboré con mis interlocutores para diseñar y dar forma a mi proyecto (Pink et al. 2016). En un esfuerzo por comprender sus actuaciones racializadas como inmigrantes calificados en el sector empresarial de China, les hice preguntas cuidadosas sobre sus trayectorias migratorias y compartí artículos con ellos sobre el sector empresarial de China para impulsar nuestras conversaciones. En el proceso, me encontré con lo que para mí era una nueva área de investigación: la construcción de la blancura dentro de la industria de inteligencia artificial (IA) de China.

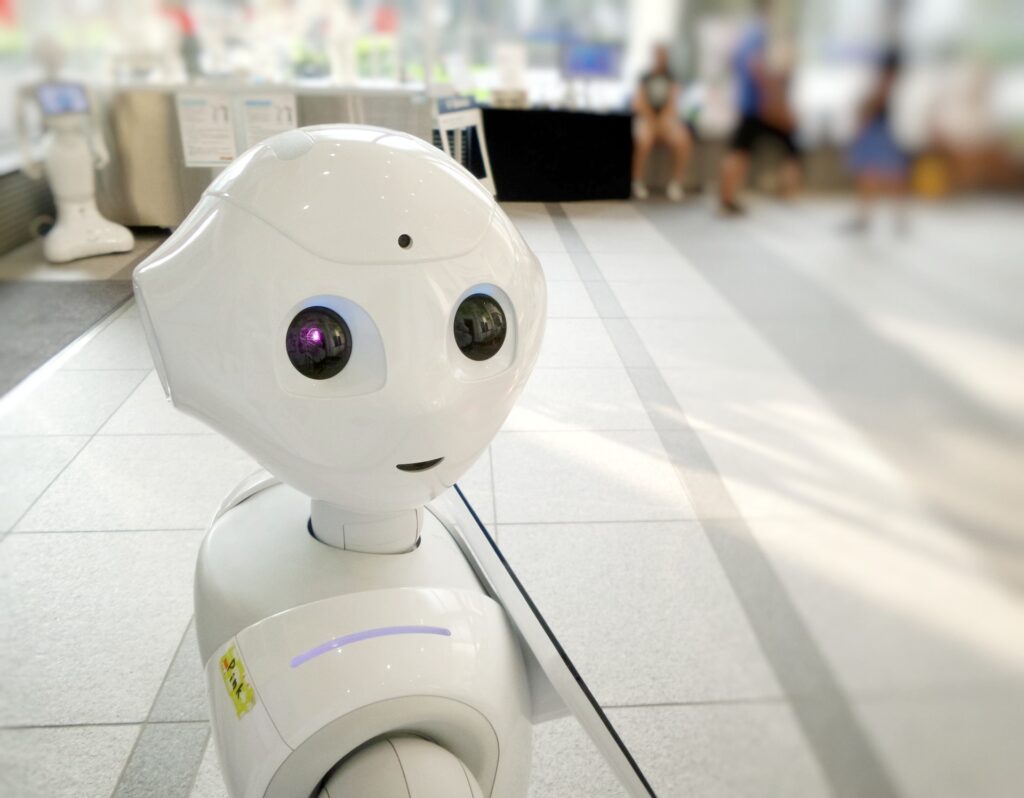

Mi entrada al mundo racializado de la IA en China se produjo cuando uno de mis interlocutores, Liam (seudónimo) del Reino Unido, me envió una foto de un evento de 2017 que tuvo lugar en la ciudad de Shenzhen (el “Silicon Valley” de China ). La foto mostraba a un robot de IA haciendo bocetos mientras usaba una boina negra, un bigote falso y un par de anteojos. Debajo de la foto, las personas en las plataformas de redes sociales de China (principalmente WeChat y Weibo) comentaron que parecía un pintor francés. Liam me había incluido un breve mensaje en inglés, en respuesta a nuestra conversación sobre cómo era para él ser un migrante blanco en China: “¿Blanco? ¿Quién es blanco? ¿Estás buscando a alguien en particular? ¡Este es quizás tu futuro participante en la investigación de habilidades!” Liam caracterizó al robot como «blanco» no solo por el material blanco brillante del que estaba hecha su «piel», sino también porque lo percibía a través de una lente de estereotipos racializados que combinaban la blancura y ciertas formas de trabajo calificado. Miré su mensaje durante bastante tiempo mientras consideraba la implicación de la tecnología de IA en mi investigación. Volví a pensar en la novela distópica de Kazuo Ishiguro, Klara and the Sun. El narrador principal de la historia es una robot con IA que funciona con energía solar, parecida a una muñeca, llamada Klara, que brinda compañía a una adolescente privilegiada. A lo largo del libro, Klara es racializada y clasificada como una mujer linda con cabello corto y pulcro que “parece” francesa. Al encontrarse con Klara, el lector no puede dejar de preguntarse qué hace que alguien sea humano. Recordé sentirme abrumada por los pensamientos sobre las relaciones entre humanos y máquinas, y esto a su vez me hizo cuestionar mis propias ideas y nociones preconcebidas sobre futuros respaldados por IA. Quería aprender más. Me preguntaba: ¿podría obtener acceso a cómo se imaginaban y actualizaban estos futuros en la industria de IA de China en este momento? Y además, ¿qué papel desempeñó la raza en esta industria y cómo se racializó la propia tecnología de IA?

El rápido auge de la tecnología de IA en China ha generado nuevas preguntas teóricas y prácticas sobre la relación entre las personas y las máquinas. Al mirar más allá de los algoritmos y los sistemas de aprendizaje automático, centré mi atención en los esfuerzos de China por convertirse en el líder mundial en tecnología de IA. Empecé a recopilar publicaciones, actualizaciones y artículos de noticias en las redes sociales que detallaban el crecimiento de la industria de IA del país, organizando en categorías las principales actividades para las que se utilizan los sistemas de IA (y están asignados para uso futuro) en toda China. También contacté a pequeñas empresas emergentes que trabajan en y con tecnología de IA. Hice preguntas a mis interlocutores sobre la capacidad tecnológica de China para construir y desarrollar sistemas tecnológicos de inteligencia artificial y robots con características distintivas, como características humanas. También acepté invitaciones para participar en eventos en línea en China relacionados con la IA y los sistemas de desarrollo de IA. Así, creé un mosaico de diferentes métodos para observar este mundo que era nuevo para mí.

Sería un error suponer que mi proceso de recopilación de datos me permitió un acceso abierto a este campo de estudio. Sin embargo, lo que sí hizo fue abrir nuevos horizontes para futuras investigaciones sobre la ética del uso del poder tecnológico con fines de vigilancia, como lo hace principalmente China. Crawford (2021) argumenta que “la IA no es ni artificial ni inteligente. Más bien, la inteligencia artificial es tanto corporizada como material, hecha de recursos naturales, combustible, trabajo humano, infraestructuras, logística, historias y clasificaciones”. En mi investigación, descubrí que las aplicaciones de IA se utilizan en casi todos los dominios humanos y se presentan como ventajas distintivas tanto en el desarrollo industrial como en el ámbito de la vigilancia. Sin embargo, una pregunta clave que surgió para mí en todo esto fue: ¿Por qué estas maquinarias terrestres se construyeron como «talentos de habilidades tecnológicas» con características humanas, como el robot en Shenzhen?

Cambiando mi enfoque a las configuraciones contemporáneas de la blancura en las industrias tecnológicas chinas, primero traté de desglosar los significados de «habilidad» y «trabajo calificado» entre los inmigrantes blancos en China. Según muchos académicos, la movilidad geográfica puede ser un factor en la definición de habilidades (Liu-Farrer, Yeoh y Baas, 2020). Según la investigación de Farrer (2019) sobre inmigrantes extranjeros en Shanghai, la raza y la nacionalidad son indispensables para definir las cualidades de las habilidades. Los estudios sobre migrantes corporativos transnacionales en Asia con frecuencia se centran en los occidentales blancos y ven las «habilidades» a través de un prisma racializado que privilegia la blancura (Camenish y Suter 2019; Farrer 2019). Al escribir sobre la blancura en China de manera más amplia, Lan (2021: 3557) afirma que “la reconfiguración de la blancura en China está mediada no solo por el color de la piel sino por diversos factores como la ciudadanía, la clase, el género, la edad, el campo de trabajo, el dominio de los idiomas chinos e inglés, y calificaciones profesionales”. Los académicos también han notado la naturaleza territorialmente delimitada de la blancura (Lan 2011; Lundström 2014). Debido a que la piel blanca a menudo se percibe como un marcador de habilidad capacitada en el extranjero en los sectores empresarial y tecnológico de China, los trabajadores blancos experimentan privilegios. Sin embargo, dado que los estereotipos raciales frecuentemente dependen de la homogeneización y la otredad, los privilegios que pueden encontrar debido a la blancura son algo contingentes y pueden transformarse rápidamente en precariedad. Entonces, ¿cómo debemos entender la construcción de la blancura dentro de la industria de la IA, y la racialización de las propias aplicaciones de la IA, dentro de este contexto más amplio de mano de obra racializada y privilegio de los blancos?

Mi investigación en curso dentro del sector de la IA me ha llevado a percibir un nuevo giro en el mercado laboral de China en el que el propio gobierno está construyendo robots y sistemas tecnológicos de IA que tienen género y raza, a menudo marcados como claramente extranjeros por su apariencia y sus características incorporadas. Las aplicaciones están diseñadas para servir como sistemas de tecnología de habilidades en una amplia gama de dominios comerciales. La imagen del robot que parecía un pintor francés, cubierto como estaba con un caparazón humanoide de plástico blanco, no solo parecía más humano que una máquina, sino que también se veía claramente blanco. Vale la pena señalar que, si bien las características físicas, como la «piel» blanca del robot, son los principales marcadores que delimitan un marco racial, la IA también incorpora «características culturales» menos tangibles (invisibles o solo semivisibles) que en sí mismas están racializadas. En mi investigación, volví a considerar el lugar de la blancura dentro de este marco racializado que domina la industria de IA de China en diferentes campos comerciales: humanos digitales de IA que pueden tener conversaciones de varios turnos con usuarios en chino e inglés; marcas de moda extranjeras y locales y plataformas de comercio electrónico, que presentan diseños virtuales en humanos virtuales de representación blanca; ídolos virtuales con características totalmente desarrolladas por IA; y empresas chinas que enseñan inglés a los estudiantes mediante el uso de algoritmos de IA para seleccionar sus cursos. Por lo tanto, mi intención es mirar a través del sector de la IA de China, como antropóloga, para ver cómo se construye la blancura dentro del desarrollo de la IA en China, y cómo se construye ella misma.

Muchos de mis interlocutores blancos que trabajaron en el sector empresarial de China discutieron los privilegios que encuentran durante su reunión de negocios con clientes chinos debido al color de su piel y mencionaron que sus títulos de prestigiosas universidades occidentales les otorgan estatus en China. Muchos de ellos también mencionaron la importancia de la marca de sus negocios de una manera que resalte su nacionalidad, su formación, sus distintos conjuntos de habilidades y su dominio del idioma inglés. Aun así, la mayoría demostró una conciencia limitada de la reproducción de la blancura en la industria tecnológica de China, incluso cuando reconocieron los privilegios que se les otorgan en su vida diaria y como actores en la próspera economía de mercado de China. Los desafíos etnográficos que enfrenté al comienzo de mi trabajo de campo podrían haberme hecho pasar por alto el trabajo de la blancura en la IA. En cambio, me centré en la racialización de los robots y los sistemas de IA, demostrando cómo estos podrían inscribir y proyectar aún más una «imaginación de utopía blanca» (Cave y Dihal 2020).

Mi participación continua en esta investigación descubrió un nuevo tema de investigación en la producción de máquinas de China: una tecnología construida racialmente que produce robots y sistemas de IA que a su vez refuerzan la hegemonía global de la raza blanca.

—

Referencias

Camenish, Aldina and Suter Brigitte. 2019. “European Migrant Professionals in Chinese Global Cities: A Diversified Labour Market Integration.” International Migration 57 (3): 208-221.

Cave, Stephen and Dihal, Kanta. 2020. “The Whiteness of AI.” Philosophy and Technology 33:685-703.

Crawford, Kate. 2021. Atlas of AI. Power, Politics, and the Planetary Costs of Artificial Intelligence. New Haven and London: Yale University Press.

Farrer, James. 2019. International Migrants in China’s Global Cities: The New Shanghailanders. London: Routledge.

Lan, Shanshan. 2021. “The foreign bully, the guest and the low-income knowledge worker: performing multiple versions of whiteness in China.” Journal of Ethnic and Migration Studies 48(15):3544-3560.

Lan, Pei-Cia. 2011. “White Privilege, Language Capital and Cultural Ghettoization: Western High- Skilled Migrants in Taiwan.” Journal of Ethnic and Migration Studies 37 (10): 1669–1693.

Liu-Farrer, Gracia, Brenda S. Yeoh, and Michiel Baas. 2020. “Social Construction of Skill: An Analytical Approach Toward the Question of Skill in Cross-Border Labour Mobilities.” Journal of Ethnic and Migration Studies 47 (10):1–15.

Pink, Sarah, Horst, Heather, Postill, John, Hjorth, Larissa, Lewis, Tania and Tacchi, Jo. 2016. Digital Ethnography. Principles and Practice. New York: Sage.

Fuente: AES/ Traducción: Maggie Tarlo